És hora que les màquines tinguin en compte la diversitat humana i la inclusió

Els investigadors estan fent un gran esforç perquè les màquines puguin identificar fàcilment als éssers humans i mantenir una comunicació cada vegada més eficaç amb ells. La millora contínua de les interfícies ha estat denunciada per investigadors de la Universitat de Purdue (els EUA) en la revista Science per seguir sense tenir en compte la diversitat humana. No sols pel que fa a l'ètnia, sinó també pel que fa a la classe social i a les capacitats. Diuen que es continua fomentant l'exclusió de la tecnologia.

A l'hora de dissenyar les recerques cal tenir en compte la diversitat humana, en cas contrari les interfícies reprodueixen els mateixos prejudicis i errors que els investigadors. Per això, els grups de recerca sobre la relació entre màquines i éssers humans han destacat la necessitat de comptar amb científics capaços d'afrontar l'hegemonia cultural. En cas contrari, les màquines no s'integraran en el nostre entorn natural, virtual, psicològic, econòmic o social.

No obstant això, en la majoria dels casos, els investigadors utilitzen a ciutadans i ciutadanes txuris d'alt nivell socioeconòmic en el procés de desenvolupament d'interfícies i, per tant, han comprovat que molts grups d'elles queden fora d'aquestes tecnologies.

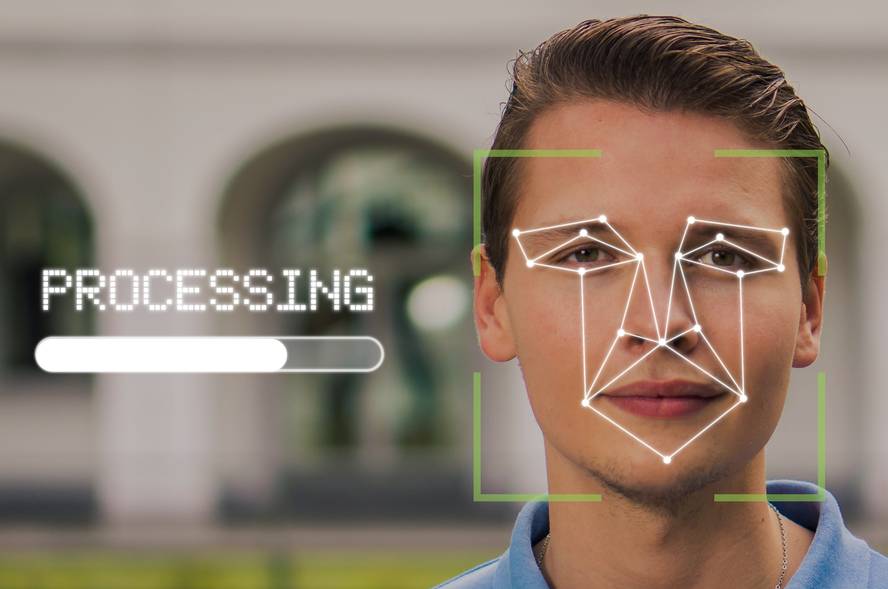

Per exemple, les interfícies constantment cometen errors en el registre i interpretació de les dades. No sols quan les persones interaccionen activament amb les màquines (per exemple, amb un vehicle autònom), sinó també en el cas d'usuaris conscients de la interacció però passius (com ocorre amb els dispositius que prenen dades per al diagnòstic mèdic), o en aquells casos en els quals no són conscients i a més es converteixen en usuaris no autoritzats de la tecnologia (tecnologies utilitzades per la policia per a l'anàlisi de cares).

Les conseqüències són greus: en entrenar-se les interfícies d'identificació de malalties cutànies amb persones de pell blanca, es produeixen grans errors en les pells fosques; els algorismes de reconeixement facial no identifiquen bé a persones racializadas; i un llarg etcètera.

Per tant, en els processos d'entrenament d'interfícies s'ha sol·licitat als investigadors que per fi integrin a ciutadans de baix nivell socioeconòmic, minories ètniques, migrants i persones amb diversitat funcional.