Para que a máquina fale da propia voz

Inma Hernaez Rioxa é profesora catedrática da Escola Superior de Enxeñaría de Bilbao e fundadora do grupo de investigación Aholkularitza. O grupo naceu en 1995 dentro da UPV/EHU e traballa a fala automática en eúscaro. Foi un traballo bastante silencioso até agora. De feito, o eco e a acollida que tivo o último proxecto, | MyTTS, foi tan grande que tiveron que suspender temporalmente o sistema.

Detrás deste éxito atópase o traballo de moitos anos e no punto de partida una vivencia persoal: A irmá de Hernaez perdeu a voz por unha operación. E a súa traxectoria foi impulsada por axudarlle a comunicarse con el e con outros. “A miña irmá foi o primeiro usuario dos nosos desenvolvementos. Nunha ocasión homenaxearon a un amigo íntimo da súa irmá, quen deu una pequena charla grazas á aplicación. Darme esa oportunidade deume moita forza paira avanzar na investigación”.

Desde os seus inicios até a actualidade, o desenvolvemento foi notable. Fai 20 anos, paira conseguir una boa calidade nas técnicas de sínteses de voz, necesitábanse moitas horas de gravación dunha persoa. Por exemplo, paira conseguir a voz que ten Siri, Hernaez dixo que tardarían unhas 30 horas. Ademais, debía gravarse nun estudo cunha calidade moi boa.

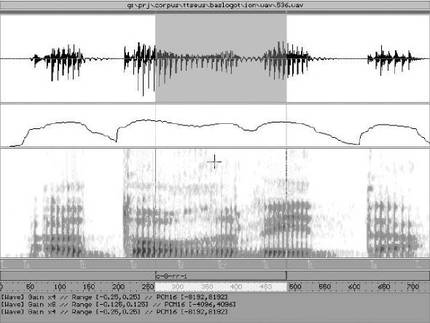

A técnica baseábase no procedemento “cortar e pegar”. Non se cortaban palabras ou frases, senón pequenas unidades: difonemas, trifonemas, vocais ou consonantes co contexto... Posteriormente, dependendo do contexto, o algoritmo determinaba que unidade escoller da base de datos. “Chamábase síntese baseada en corpus. Era moi caro”, precisou.

Utilidade e calidade

O seguinte paso remóntase ao ano 2002 grazas á síntese estatístico-paramétrica. Esta técnica consiste, en primeiro lugar, na parametrización dos sinais de voz e, posteriormente, na interconexión destes parámetros mediante un tratamento estatístico. Explica que a calidade non é tan boa como a do sistema anterior, pero con moito menos gravación conséguese un resultado aceptable. Ademais, o seu carácter estatístico confírelle una gran flexibilidade ao poder adaptar o modelo estatístico a calquera mostra.

Así explica o proceso. “Temos voz media. Esa voz non é de ninguén, está feita con moitas voces e relatoras. Non son calquera relator, adoitan ser relatores profesionais, a voz media obtense a partir da súa gravación. Despois, esta voz pódese adaptar á voz de calquera usuario, paira o que basta con ter una mostra de cen frases”.

Nestas cen frases hai todas as combinacións sonoras e a gravación dura media hora. O avance é evidente, xa que facilita enormemente que calquera persoa teña una voz sintética adaptada á súa voz. “De feito, si gravamos máis frases conséguese una mellor calidade, pero non podemos pedir máis esforzo que iso”, di Hernaez.

Ten outras limitacións. Por exemplo, non é capaz de expresar emocións: “Gravando un corpus con emocións pódese conseguir, pero neste proxecto as frases son neutras e non facemos a análise do texto paira buscar emocións. Con todo, pódese pór no texto, pero non o facemos”.

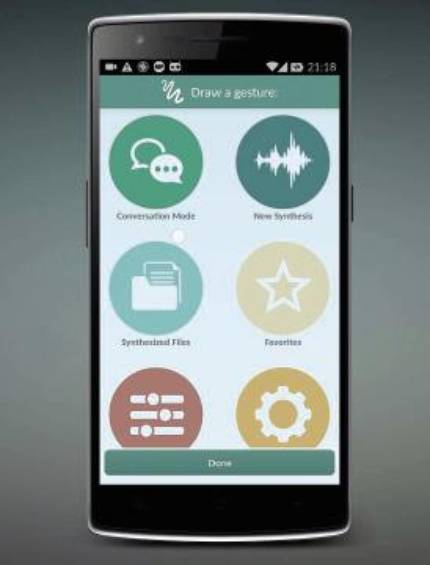

Pero as vantaxes son evidentes: o sintetizador non colle memoria, hano implementado facilmente en Android, funciona en tempo real no móbil... Todo iso permite a calquera persoa utilizalo no seu día a día. E ese era o obxectivo inicial.

De feito, Hernaez recoñeceu que existen na actualidade sistemas que ofrecen una maior calidade, especialmente baseados en redes neuronais: “A tecnoloxía actual de síntese é moi boa. Eu ensinaríache algunhas frases e ti non serías capaz de distinguir si é sintético ou natural. Pero non poderiamos entrar en Android ou utilizalo en tempo real”.

Do laboratorio ao usuario

E esa é a sangría: no día a día as persoas que necesitan voz sintética paira comunicarse teñen que utilizar os sistemas que hai e son moi limitados. Así, en moitos casos, as mulleres deben utilizar a voz humana; ou os falantes de linguas minorizadas, a linguaxe hexemónica; ou os nenos, o de Siri. O obxectivo de Hobe foi reducir a distancia entre a voz do usuario e a que ofrece o sintetizador.

Procurouse que o sistema desenvolvido sexa o máis cómodo e sinxelo posible paira o usuario. O funcionamento é o seguinte: “O usuario grava primeiro esas cen frases, en eúscaro ou en castelán, e créase automaticamente una aplicación coa súa voz sintética. A continuación recibirao por correo electrónico e só terá que facer click paira baixalo ao seu móbil Android. A voz grávase como voz do sistema, polo que pode utilizala non só na nosa aplicación de comunicación, senón tamén noutras aplicacións como ler libros en moitos e-reader ou en Adobe. E pódense comunicar en tempo real”.

Pola súa banda, as persoas con mobilidade moi limitada utilizan tablet e panca ou lector de iris. Neste caso intégrano en Windows.

Entre os usuarios atópanse as persoas con esclerose lateral amiotrófica. En principio, o proxecto pretende axudar a calquera persoa que perda a súa voz, pero cando a perda é repentina (por exemplo, debido a un ictus), é difícil conseguir a súa voz sintética. Pola súa banda, as persoas con esclerose lateral amiotrófica perden progresivamente a súa capacidade de movemento. Por tanto, desde que reciben o diagnóstico teñen tempo paira realizar a gravación e crear a súa propia voz sintética.

No últimos tres ou catro anos, xunto con Biocruces, traballaron con pacientes aos que había que facer laringectomía. ”Os laringectomizados poden falar coa voz esofágica, pero con esta colaboración os médicos informaban aos pacientes paira realizar a gravación antes da intervención. Así que despois tiñan a aplicación, porque nas primeiras semanas non poden falar”, explica Hernaez. Di que esta colaboración deu un gran impulso ao proxecto.

Agora seguen traballando paira mellorar a calidade (teñen un novo algoritmo) e paira acurtar o camiño que se fai desde o laboratorio ao usuario. Tamén se está facendo un esforzo para que a voz do neno estea dispoñible, mesmo noutras linguas, como o catalán. Obxectivo final: que todas as persoas que o necesiten teñan a posibilidade de comunicarse a través da voz sintética da maneira máis personalizada, natural e sinxela posible.